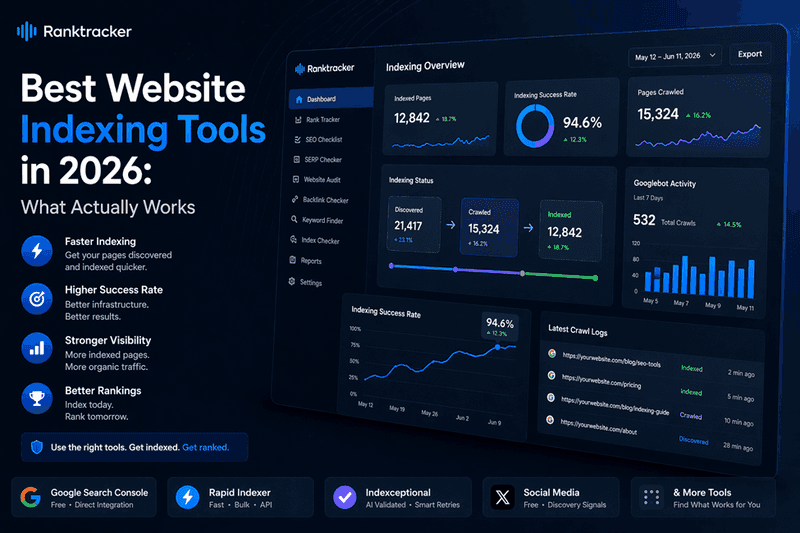

Introduktion

At offentliggøre en side betyder ikke, at Google har fundet den.

Forskellen mellem, at en URL går live, og at Google tilføjer den til indekset, er et af de mest undervurderede problemer inden for SEO. For indholdstunge websteder, linkbyggere og bureauer, der administrerer flere kampagner, betyder denne forskel direkte forsinkede placeringer, spildt linkværdi og langsommere afkast på indholdsinvesteringer.

Der findes værktøjer til indeksering af hjemmesider, der kan lukke dette hul – ved at skabe crawl-signaler, opbygge opdagelsesveje og i nogle tilfælde gentagne gange indsende URL'er, indtil de er bekræftet indekseret.

Denne guide dækker de værktøjer, der er værd at bruge i 2026, baseret på test i live-kampagner, med noter om, hvor hvert enkelt passer ind i en praktisk arbejdsgang.

Hvorfor der opstår forsinkelser i indekseringen

Google tildeler et crawl-budget til hvert domæne – en begrænset mængde ressourcer, som Googlebot bruger til at opdage og behandle sider. I takt med at internettet vokser, bliver dette budget spredt tyndere.

Det praktiske resultat er to almindelige GSC-fejltilstande, som de fleste SEO'er kender godt:

Alt-i-en-platformen til effektiv SEO

Bag enhver succesfuld virksomhed ligger en stærk SEO-kampagne. Men med utallige optimeringsværktøjer og -teknikker at vælge imellem kan det være svært at vide, hvor man skal starte. Nå, frygt ikke mere, for jeg har lige det, der kan hjælpe dig. Jeg præsenterer Ranktracker alt-i-en platformen til effektiv SEO

Vi har endelig åbnet for gratis registrering til Ranktracker!

Opret en gratis kontoEller logge ind med dine legitimationsoplysninger

"Fundet – ikke indekseret i øjeblikket" betyder, at Google har fundet URL'en (normalt via sitemap), men endnu ikke har sendt Googlebot ud for at gennemgå den. Dette er et køproblem – din side venter på sin tur.

"Gennemgået – ikke indekseret i øjeblikket" betyder, at Googlebot har besøgt siden, men har besluttet ikke at medtage den i indekset. Dette er et kvalitets- eller relevansproblem – værktøjet har gjort sit arbejde, men indholdet har ikke opfyldt Googles krav.

Indekseringsværktøjer løser det første problem pålideligt. Det andet kræver en forbedring af den underliggende side. Den skelnen er vigtig, når man skal vælge, hvor budgettet skal bruges.

Værktøjerne

1. Google Search Console

Den gratis løsning udviklet af Google selv – og den mest etiske tilgang til sider, du ejer og kontrollerer direkte. Med værktøjet URL-inspektion kan du manuelt anmode om indeksering af enhver URL på en verificeret ejendom. For nyt indhold, opdaterede sider eller alt, der er markeret i dækningsrapporten, er en manuel anmodning den reneste og gratis løsning, der findes. Der er tre væsentlige begrænsninger, du bør kende, før du stoler på det. For det første er det stærkt begrænset – du kan kun indsende et lille antal URL'er manuelt om dagen, hvilket gør det upraktisk til indeksering af store mængder. For det andet fungerer det kun for domæner, hvor du har verificeret ejerskab – for tredjeparts backlink-sider, gæsteindlæg eller enhver URL på et andet domæne er det ikke en mulighed. For det tredje kan indeksering, selv når en anmodning er indsendt med succes, stadig tage dage i stedet for de få minutter, som betalte værktøjer som Rapid Indexer opnår. Det er den reneste metode, der findes, men ikke den hurtigste.

Bedst egnet til: Egne sider, nyt indhold, løsning af GSC-fejl

Pris: Gratis

2. Rapid Indexer

Den stærkeste betalte løsning, der i øjeblikket er tilgængelig med hensyn til hastighed og infrastrukturdybde – og et af to værktøjer på denne liste, der tilbyder AI-validerede indsendelser.

Rapid Indexer har to indsendelsesniveauer. Standardkøen bruger et autoritetsnetværk med gradvis tilførsel til at behandle masseindsendelser inden for 24-48 timer – velegnet til citater, Tier 2/3-links og store batcher, hvor gradvis opdagelse ser naturlig ud. VIP-køen er bygget til sider med høj prioritet og opnåede crawl-opdagelse på under to minutter i vores test – det hurtigste resultat, vi registrerede blandt alle testede værktøjer.

Alt-i-en-platformen til effektiv SEO

Bag enhver succesfuld virksomhed ligger en stærk SEO-kampagne. Men med utallige optimeringsværktøjer og -teknikker at vælge imellem kan det være svært at vide, hvor man skal starte. Nå, frygt ikke mere, for jeg har lige det, der kan hjælpe dig. Jeg præsenterer Ranktracker alt-i-en platformen til effektiv SEO

Vi har endelig åbnet for gratis registrering til Ranktracker!

Opret en gratis kontoEller logge ind med dine legitimationsoplysninger

Den underliggende mekanisme kombinerer cloud-API-signalering med feed-injektion med høj autoritet, hvilket udløser reelle Googlebot-besøg, der kan verificeres uafhængigt via overvågningsværktøjer til crawl-logfiler. Før behandlingen valideres URL'er for HTTP-responsstatus og crawl-parathed – så kreditter ikke spildes på 404-fejl eller ødelagte omdirigeringer. URL'er, der ikke indekseres ved første gennemgang, indsendes automatisk igen ved hjælp af adaptiv genforsøgslogik.

Det inkluderer også et AI-trafikmodul, der genererer engagementssignaler (CTR, opholdstid, scroll-dybde) via private IP-adresser – relevant for sider, hvor brugeradfærdssignaler er vigtige sideløbende med ren indeksering.

For bureauer tilbyder det bulkbehandling af op til 10.000 URL'er, API-adgang, Zapier/Make/n8n-integration, et WordPress-plugin, white-label CSV-rapportering og automatisk refusion ved indekseringsfejl.

Bedst til: Hurtig Tier 1-indeksering, agentur-workflows, bulk-kampagner

Pris: $0,001/URL (checking), $0,02/URL (Standard), $0,10/URL (VIP)

3. Indexceptional

Indexceptional blev grundlagt af James Dooley og Leo Soulas i midten af 2024 og dækker de samme kernefunktioner som Rapid Indexer – AI-drevet URL-validering, adaptiv genforsøgslogik ved mislykkede indsendelser og private crawl-netværk med intelligent ping-planlægning for konsistent indeksering på lang sigt.

Den væsentligste forskel er kreditrefusionspolitikken. For enhver URL, der ikke bliver indekseret, tilbagebetales kreditten automatisk – hvilket betyder, at du kun betaler for bekræftede resultater. Denne garanti tilføjer et lag af økonomisk beskyttelse, der gør den særligt velegnet til større batcher, hvor der forventes nogle indekseringsfejl.

Ulempen er prisen – Indexceptional er lidt dyrere pr. URL end Rapid Indexer og inkluderer ikke et trafiksimuleringsmodul. For kampagner, hvor refusionsgarantien opvejer meromkostningen, er det et stærkt alternativ til eller i stedet for Rapid Indexer.

Bedømt til 4,8 stjerner ud af over 300 verificerede anmeldelser og vandt en community SEO utility-pris i 2025.

Bedst til: AI-valideret indeksering med refusionsbeskyttelse, bureauer, der ønsker garanteret udgifts effektivitet

Pris: 29 $ (60 kreditter) til 499 $ (2.000 kreditter). 1 kredit = 1 URL. Ugyldige URL'er og omdirigerings-URL'er debiteres ikke. Kreditter refunderes for ikke-indekserede links.

4. Deling på sociale medier

En gratis metode, der er værd at kende til – med vigtige forbehold vedrørende pålidelighed og omfang.

Når en URL deles offentligt på Twitter/X, Reddit, LinkedIn eller lignende platforme med høj crawl-frekvens, oprettes der en crawlbar side, som Googlebot kan følge. På platforme med høj crawl-frekvens som Reddit og Twitter/X kan dette nogle gange udløse opdagelse inden for få timer efter offentliggørelsen.

Det vigtigste praktiske detalje: Del selve URL'en til backlink-siden, ikke kun din pengeside. Hvis et gæsteindlæg eller en niche-redigering skal indekseres, skaber deling af den specifikke URL en opdagelsesvej, der peger direkte på den side, der skal findes.

Begrænsningerne er dog reelle. Crawling fra delinger på sociale medier er ikke garanteret – Googlebot følger måske eller måske ikke linket afhængigt af platformens crawl-mønstre på det pågældende tidspunkt. Det kan heller ikke skaleres praktisk for store link-batches, og signalstyrken er inkonsekvent sammenlignet med betalte værktøjer.

Hvor det virkelig tilfører værdi, er i den nedstrøms effekt. Delinger på sociale medier driver reel trafik til sider, og reel trafik skaber ægte engagementssignaler – tid på siden, tilbagevendende besøg, klikmønstre – som kan understøtte placeringer ud over den indledende indeksering. For vigtige sider giver kombinationen af en betalt indekseringsværktøj og forstærkning på sociale medier både pålidelig opdagelse og løbende placeringssignaler.

Bedst til: Supplerende opdagelsessignaler, at drive ægte trafik til vigtige sider, gratis oprettelse af crawl-stier

Omkostninger: Gratis

Bemærk: Ikke pålidelig som en selvstændig indekseringsmetode i stor skala

5. Backlink-indekseringsværktøj

I drift siden 2021 med en politik, der adskiller sig fra resten af markedet: automatisk kreditrefusion for enhver URL, der ikke bliver indekseret. Du betaler kun for bekræftede resultater.

Det kører parallelle signaler på tværs af Googlebot, Bingbot og Yandex – en bredere søgemaskinedækning end værktøjer, der udelukkende fokuserer på Google. Den gennemsnitlige succesrate i vores test ligger på 89 %, hvor de fleste links indekseres inden for 1-5 dage, og den første Googlebot-crawling typisk finder sted inden for 1-6 timer efter indsendelse.

Refusionspolitikken fjerner den økonomiske risiko ved store bulk-kampagner på en måde, som intet andet værktøj i øjeblikket kan matche.

Bedst til: Bulk-backlink-kampagner, risikofri udgift til store batcher

Pris: $30 (100 kreditter), $135 (500 kreditter), $510 (2.000 kreditter)

6. Indx.it

Et indekseringsværktøj med hurtig ekspeditionstid, der rapporterer opdagelsestider på 1-5 minutter – sammenligneligt med Rapid Indexers VIP-kø med hensyn til hastighed.

Fungerer efter en pay-as-you-go-kreditmodel uden krav om abonnement. Prisen ligger lidt over Rapid Indexer pr. URL. Dashboardet er ligetil for både enkeltindsendelser og gentagen brug.

Et nyttigt sekundært valg til Tier 1-links, hvor hastighed er en prioritet, og hvor det foretrækkes at sprede indsendelser over mere end én infrastruktur.

Bedst egnet til: Tier 1-indsendelser med hurtig behandling, diversificering af infrastruktur

Pris: Betal-efter-forbrug, kreditter udløber ikke

7. Giga Indexer

Den mest fleksible mulighed på denne liste til at kontrollere indsendelsestempoet – drip-feed-vinduerne løber fra øjeblikkeligt til 30 dage.

For store linkbatcher, hvor et gradvist, naturligt udseende opdagelsesmønster er vigtigt, er dette niveau af kontrol over tempoet virkelig nyttigt. Succesraten ligger på 80 % inden for 72 timer i vores test, med en 9-dages refusionsgaranti på ikke-indekserede links.

**Bedst til: **Store batcher, der kræver gradvis indsendelse, Tier 2/3-links

**Pris: **29 $ (60 kreditter), 99 $ (260 kreditter), 499 $ (2.000 kreditter)

Hvad indekseringsværktøjer ikke kan

Det er værd at gøre opmærksom på, inden du bruger penge på noget af ovenstående.

Et indekseringsværktøj får Googlebot til at besøge en URL. Det kan ikke kontrollere, hvad Google beslutter, når den ankommer. Hvis siden har tyndt indhold, duplikeret tekst eller ikke tilføjer noget nyt til indekset, vil Google gennemgå den og forlade den uden at indeksere den. Værktøjet fungerede. Siden bestod ikke.

Nogle få faktorer, der direkte påvirker, om en crawlet side bliver indekseret og bevaret:

**Indholdskvalitet og dybde **- Sider, der dækker et emne grundigt, besvarer en ægte forespørgsel og tilfører noget nyt til indekset, klarer sig bedre end tyndt eller tæt omskrevet indhold, uanset hvor mange crawl-signaler der sendes.

Alt-i-en-platformen til effektiv SEO

Bag enhver succesfuld virksomhed ligger en stærk SEO-kampagne. Men med utallige optimeringsværktøjer og -teknikker at vælge imellem kan det være svært at vide, hvor man skal starte. Nå, frygt ikke mere, for jeg har lige det, der kan hjælpe dig. Jeg præsenterer Ranktracker alt-i-en platformen til effektiv SEO

Vi har endelig åbnet for gratis registrering til Ranktracker!

Opret en gratis kontoEller logge ind med dine legitimationsoplysninger

**Sidestruktur **- En klar overskriftshierarki (H1, H2, H3), logisk flow og korrekt intern linking hjælper Googlebot med at forstå og kategorisere en side. Velstrukturerede sider er nemmere at bevare i indekset end dårligt organiserede sider.

**Teknisk tilstand **- Langsomme indlæsningstider, blokerede ressourcer, ødelagte elementer og modstridende kanoniske tags giver alle Googlebot grund til at nedprioritere en side. At bestå Core Web Vitals og holde siderne teknisk rene fjerner friktion fra processen.

**Linksignaler **- Sider uden interne links og uden eksterne opdagelsessignaler ser ud til at have lav prioritet. At opbygge noget linkværdighed til en side før eller sideløbende med indsendelse til indeksering forbedrer chancen for, at en crawlet side forbliver indekseret i stedet for at falde ud igen.

Indekseringsværktøjer er mest effektive, når den underliggende sidekvalitet allerede opfylder Googles tærskel. At få Googlebot dertil hurtigere ændrer ikke, hvad den beslutter, når den ankommer.

Anbefalet arbejdsgang

| Scenarie | Anbefalet tilgang |

| Dine egne sider | Google Search Console først – gratis og white-hat |

| Tidsfølsomt Tier 1-indhold | Rapid Indexer VIP-kø eller Indx.it |

| AI-valideret præcisionsindeksering | Indexceptional (kreditrefusion ved fejl) |

| Tredjeparts-backlinks, bulk | Backlink-indekseringsværktøj (automatisk refusion dækker risikoen) |

| Store batcher, gradvis tempo | Giga Indexer dryp-feed |

| Rankingsignaler + trafikforøgelse | Deling på sociale medier sideløbende med betalt indeksering |

Den mest pålidelige fremgangsmåde er at kombinere gratis metoder til eget indhold med en betalt indekseringsværktøj til tredjepartssider – i stedet for automatisk at benytte betalte værktøjer over hele linjen. Deling på sociale medier fungerer bedst som et supplement til betalt indeksering på vigtige sider, ikke som en erstatning for den. I forbindelse med konkurrencedygtige kampagner giver det et mere præcist billede af, hvad der rent faktisk er blevet indekseret, og hvad der stadig står i kø, hvis man bruger et primært indekseringsværktøj sideløbende med et verifikationstrin.