Wprowadzenie

Opublikowanie strony nie oznacza, że Google ją znalazł.

Różnica między opublikowaniem adresu URL a dodaniem go przez Google do indeksu jest jednym z najbardziej niedocenianych problemów w SEO. W przypadku witryn z dużą ilością treści, osób zajmujących się budowaniem linków oraz agencji zarządzających wieloma kampaniami ta różnica przekłada się bezpośrednio na opóźnienia w rankingach, zmarnowany potencjał linków i wolniejszy zwrot z inwestycji w treści.

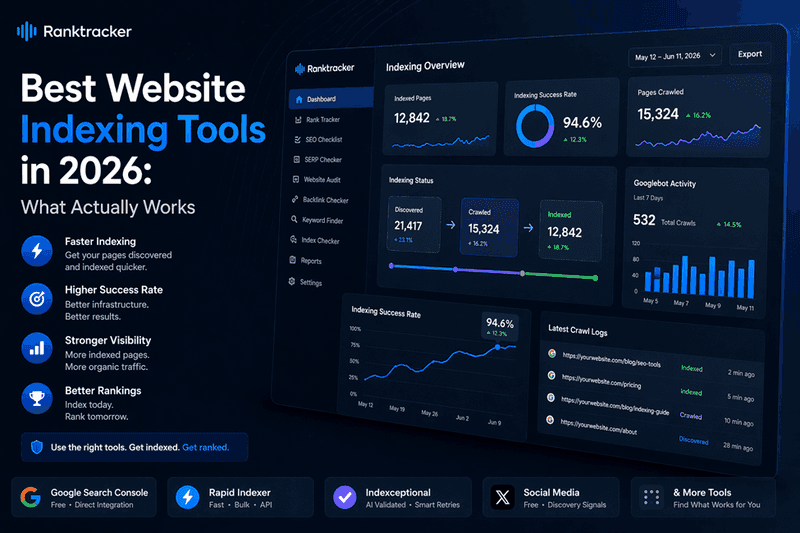

Istnieją narzędzia do indeksowania stron internetowych, które pozwalają zniwelować tę lukę – poprzez generowanie sygnałów indeksowania, tworzenie ścieżek odkrywania oraz, w niektórych przypadkach, wielokrotne ponowne zgłaszanie adresów URL do momentu potwierdzenia ich indeksacji.

W niniejszym przewodniku omówiono narzędzia, z których warto korzystać w 2026 r., w oparciu o testy przeprowadzone w ramach rzeczywistych kampanii, wraz z uwagami na temat tego, gdzie każde z nich pasuje do praktycznego przepływu pracy.

Dlaczego występują opóźnienia w indeksowaniu

Google przydziela każdej domenie budżet indeksowania – ograniczoną ilość zasobów, które Googlebot wykorzystuje do odkrywania i przetwarzania stron. Wraz z rozwojem sieci budżet ten jest coraz bardziej rozdzielany.

W praktyce skutkuje to dwoma typowymi stanami błędów w GSC, które większość specjalistów SEO dobrze zna:

Platforma "wszystko w jednym" dla skutecznego SEO

Za każdym udanym biznesem stoi silna kampania SEO. Ale z niezliczonych narzędzi optymalizacji i technik tam do wyboru, może być trudno wiedzieć, gdzie zacząć. Cóż, nie obawiaj się więcej, ponieważ mam właśnie coś, co może pomóc. Przedstawiamy Ranktracker - platformę all-in-one dla skutecznego SEO.

W końcu otworzyliśmy rejestrację do Ranktrackera całkowicie za darmo!

Załóż darmowe kontoLub Zaloguj się używając swoich danych uwierzytelniających

„Wykryto – obecnie nieindeksowane” oznacza, że Google znalazło adres URL (zwykle poprzez mapę witryny), ale nie wysłało jeszcze Googlebota do jego indeksowania. Jest to problem związany z kolejką – Twoja strona czeka na swoją kolej.

„Przeskanowano – obecnie nieindeksowane” oznacza, że Googlebot odwiedził stronę, ale zdecydował się nie umieszczać jej w indeksie. Jest to problem związany z jakością lub trafnością – narzędzie wykonało swoje zadanie, ale treść nie spełniła wymagań Google.

Narzędzia do indeksowania niezawodnie rozwiązują pierwszy problem. Drugi wymaga poprawy samej strony. To rozróżnienie ma znaczenie przy podejmowaniu decyzji, na co przeznaczyć budżet.

Narzędzia

1. Google Search Console

Bezpłatna opcja stworzona przez samą firmę Google – i najbardziej „white hatowe” podejście dostępne dla stron, które posiadasz i kontrolujesz bezpośrednio. Narzędzie do sprawdzania adresów URL pozwala ręcznie zlecić indeksowanie dowolnego adresu URL w zweryfikowanej witrynie. W przypadku nowych treści, zaktualizowanych stron lub wszystkiego, co zostało oznaczone w raporcie zasięgu, ręczne zgłoszenie jest najczystszym dostępnym rozwiązaniem bez żadnych kosztów. Istnieją trzy istotne ograniczenia, o których warto wiedzieć, zanim się na nim opierasz. Po pierwsze, jest ono mocno ograniczone pod względem częstotliwości – dziennie można ręcznie zgłosić tylko niewielką liczbę adresów URL, co sprawia, że nie nadaje się ono do indeksowania zbiorczego. Po drugie, działa tylko w przypadku domen, których własność została zweryfikowana – w przypadku stron z linkami zwrotnymi stron trzecich, postów gościnnych lub dowolnego adresu URL w innej domenie nie jest to opcja. Po trzecie, nawet jeśli żądanie zostanie pomyślnie przesłane, indeksowanie może nadal trwać kilka dni, a nie kilka minut, jak w przypadku płatnych narzędzi, takich jak Rapid Indexer. Jest to najczystsza dostępna metoda, ale nie najszybsza.

Najlepsze zastosowanie: Strony własne, świeże treści, usuwanie błędów w GSC

Koszt: bezpłatne

2. Rapid Indexer

Najlepsza obecnie dostępna płatna opcja pod względem szybkości i rozbudowy infrastruktury – oraz jedno z dwóch narzędzi na tej liście oferujących zgłoszenia zweryfikowane przez sztuczną inteligencję.

Rapid Indexer działa na dwóch poziomach zgłoszeń. Kolejka standardowa wykorzystuje sieć autorytetów zasilaną stopniowo, aby przetwarzać zgłoszenia zbiorcze w ciągu 24–48 godzin – nadaje się do cytatów, linków poziomu 2/3 oraz dużych partii, gdzie stopniowe odkrywanie wygląda naturalnie. Kolejka VIP jest stworzona dla stron o wysokim priorytecie i w naszych testach osiągnęła odkrycie indeksowania w mniej niż dwie minuty – najszybszy wynik, jaki odnotowaliśmy wśród wszystkich testowanych narzędzi.

Platforma "wszystko w jednym" dla skutecznego SEO

Za każdym udanym biznesem stoi silna kampania SEO. Ale z niezliczonych narzędzi optymalizacji i technik tam do wyboru, może być trudno wiedzieć, gdzie zacząć. Cóż, nie obawiaj się więcej, ponieważ mam właśnie coś, co może pomóc. Przedstawiamy Ranktracker - platformę all-in-one dla skutecznego SEO.

W końcu otworzyliśmy rejestrację do Ranktrackera całkowicie za darmo!

Załóż darmowe kontoLub Zaloguj się używając swoich danych uwierzytelniających

Mechanizm ten łączy sygnalizację API w chmurze z wstrzykiwaniem treści o wysokim autorytecie, wywołując rzeczywiste wizyty Googlebota, które można niezależnie zweryfikować za pomocą narzędzi do monitorowania logów indeksowania. Przed przetworzeniem adresy URL są sprawdzane pod kątem statusu odpowiedzi HTTP i gotowości do indeksowania – dzięki czemu kredyty nie są marnowane na błędy 404 lub uszkodzone przekierowania. Adresy URL, które nie zostaną zindeksowane przy pierwszym przejściu, są automatycznie ponownie zgłaszane przy użyciu adaptacyjnej logiki ponownych prób.

Zawiera również moduł ruchu AI, który generuje sygnały zaangażowania (CTR, czas przebywania, głębokość przewijania) za pośrednictwem prywatnych adresów IP – istotne dla stron, na których oprócz czystej indeksacji liczą się również sygnały zachowań użytkowników.

Dla agencji oferuje przetwarzanie zbiorcze do 10 000 adresów URL, dostęp do API, integrację z Zapier/Make/n8n, wtyczkę WordPress, raportowanie CSV typu white-label oraz automatyczne zwroty kosztów w przypadku niepowodzeń indeksowania.

Najlepsze zastosowanie: Szybka indeksacja Tier 1, procesy agencji, kampanie zbiorcze

Ceny: 0,001 USD/adres URL (wersja testowa), 0,02 USD/adres URL (wersja standardowa), 0,10 USD/adres URL (wersja VIP)

3. Indexceptional

Założona przez Jamesa Dooleya i Leo Soulasa w połowie 2024 roku, Indexceptional oferuje ten sam zestaw podstawowych funkcji co Rapid Indexer – walidację adresów URL opartą na sztucznej inteligencji, adaptacyjną logikę ponownych prób w przypadku nieudanych zgłoszeń oraz prywatne sieci indeksujące z inteligentnym planowaniem pingów, zapewniające spójną, długoterminową indeksację.

Kluczową różnicą jest polityka zwrotu środków. W przypadku każdego adresu URL, który nie zostanie zindeksowany, środki są automatycznie zwracane – oznacza to, że płacisz tylko za potwierdzone wyniki. Gwarancja ta zapewnia dodatkową ochronę finansową, dzięki czemu rozwiązanie to szczególnie dobrze sprawdza się w przypadku większych partii, gdzie można spodziewać się pewnych niepowodzeń w indeksowaniu.

Kompromisem jest cena – Indexceptional jest nieco droższy w przeliczeniu na adres URL niż Rapid Indexer i nie zawiera modułu symulacji ruchu. W przypadku kampanii, w których gwarancja zwrotu kosztów przeważa nad wyższą ceną, jest to dobra opcja jako uzupełnienie lub zamiennik Rapid Indexer.

Oceniony na 4,8 gwiazdek w ponad 300 zweryfikowanych recenzjach i zdobył nagrodę społecznościową za narzędzie SEO w 2025 roku.

Najlepsze zastosowanie: indeksowanie zweryfikowane przez AI z ochroną zwrotu kosztów, agencje poszukujące gwarantowanej efektywności wydatków

Ceny: od 29 USD (60 kredytów) do 499 USD (2000 kredytów). 1 kredyt = 1 adres URL. Nieprawidłowe adresy URL i adresy przekierowań nie są rozliczane. Kredyty są zwracane za linki, które nie zostały zindeksowane.

4. Udostępnianie w mediach społecznościowych

Warto znać tę darmową metodę – z ważnymi zastrzeżeniami dotyczącymi niezawodności i skali.

Kiedy adres URL jest udostępniany publicznie na Twitterze/X, Reddicie, LinkedIn lub podobnych platformach o wysokiej częstotliwości indeksowania, tworzy to stronę, którą może indeksować robot Googlebot. Na platformach o wysokiej częstotliwości indeksowania, takich jak Reddit i Twitter/X, może to czasami spowodować wykrycie w ciągu kilku godzin od opublikowania.

Kluczowy szczegół praktyczny: udostępniaj adres URL samej strony z linkiem zwrotnym, a nie tylko swojej strony głównej. Jeśli post gościnny lub edycja niszowa muszą zostać zindeksowane, udostępnienie tego konkretnego adresu URL tworzy ścieżkę odkrycia wskazującą bezpośrednio na stronę, która ma zostać znaleziona.

Ograniczenia są jednak realne. Indeksowanie z udostępnień w mediach społecznościowych nie jest gwarantowane – Googlebot może podążać za linkiem lub nie, w zależności od wzorców indeksowania platformy w danym momencie. Nie skaluje się to również praktycznie w przypadku dużych partii linków, a siła sygnału jest niejednolita w porównaniu z płatnymi narzędziami.

Prawdziwą wartość dodaną stanowi efekt następczy. Udostępnienia w mediach społecznościowych generują rzeczywisty ruch na stronach, a rzeczywisty ruch tworzy autentyczne sygnały zaangażowania – czas spędzony na stronie, powtórne wizyty, wzorce kliknięć – które mogą wspierać pozycjonowanie w rankingu poza początkowym indeksowaniem. W przypadku ważnych stron połączenie płatnego indeksatora z wzmocnieniem w mediach społecznościowych zapewnia zarówno niezawodne wykrywanie, jak i stałe sygnały rankingowe.

Najlepsze zastosowanie: dodatkowe sygnały wykrywania, generowanie prawdziwego ruchu na ważnych stronach, bezpłatne tworzenie ścieżek indeksowania

Koszt: Bezpłatne

Uwaga: Niewiarygodne jako samodzielna metoda indeksowania na dużą skalę

5. Narzędzie do indeksowania linków zwrotnych

Działa od 2021 roku, wyróżniając się na tle reszty rynku jedną zasadą: automatycznym zwrotem środków za każdy adres URL, który nie zostanie zindeksowany. Płacisz tylko za potwierdzone wyniki.

Narzędzie to generuje równoległe sygnały w Googlebot, Bingbot i Yandex – zapewniając szerszy zasięg wyszukiwarek niż narzędzia skupiające się wyłącznie na Google. Średni wskaźnik skuteczności w naszych testach wynosi 89%, przy czym większość linków jest indeksowana w ciągu 1–5 dni, a wstępne indeksowanie przez Googlebot następuje zazwyczaj w ciągu 1–6 godzin od zgłoszenia.

Polityka zwrotów eliminuje ryzyko finansowe związane z dużymi kampaniami masowymi w sposób, którego obecnie nie oferuje żadne inne narzędzie.

Najlepsze zastosowanie: masowe kampanie linków zwrotnych, bezryzykowne wydatki na duże partie

Ceny: 30 USD (100 kredytów), 135 USD (500 kredytów), 510 USD (2000 kredytów)

6. Indx.it

Narzędzie do indeksowania o szybkim czasie realizacji, zgłaszające czas wykrycia wynoszący 1–5 minut – porównywalne pod względem szybkości z kolejką VIP w Rapid Indexer.

Działa w modelu kredytowym typu „pay-as-you-go”, bez konieczności wykupywania subskrypcji. Ceny są nieco wyższe niż w Rapid Indexer w przeliczeniu na adres URL. Pulpit nawigacyjny jest prosty w obsłudze zarówno w przypadku pojedynczych zgłoszeń, jak i regularnego użytkowania.

Przydatna opcja dodatkowa dla linków Tier 1, gdzie priorytetem jest szybkość i preferowane jest rozłożenie zgłoszeń na więcej niż jedną infrastrukturę.

Najlepsze zastosowanie: szybkie zgłoszenia Tier 1, dywersyfikacja infrastruktury

Ceny: Płatność zgodnie z rzeczywistym zużyciem, kredyty nie tracą ważności

7. Giga Indexer

Najbardziej elastyczna opcja na tej liście, jeśli chodzi o kontrolowanie tempa zgłoszeń – okna „drip-feed” trwają od natychmiastowego do 30 dni.

W przypadku dużych partii linków, gdzie liczy się stopniowy, naturalnie wyglądający wzorzec odkrywania, ten poziom kontroli tempa jest naprawdę przydatny. W naszych testach wskaźnik sukcesu wynosi 80% w ciągu 72 godzin, a na linki, które nie zostały zindeksowane, obowiązuje 9-dniowa gwarancja zwrotu pieniędzy.

**Najlepsze dla: **Dużych partii wymagających stopniowego przesyłania, linków poziomu 2/3

**Ceny: **29 USD (60 kredytów), 99 USD (260 kredytów), 499 USD (2000 kredytów)

Czego narzędzia do indeksowania nie potrafią

Warto to jasno stwierdzić przed wydaniem pieniędzy na którekolwiek z powyższych narzędzi.

Narzędzie do indeksowania sprawia, że Googlebot odwiedza adres URL. Nie może jednak kontrolować tego, co Google zdecyduje po przybyciu na stronę. Jeśli strona ma ubogą treść, zduplikowany tekst lub nie wnosi nic nowego do indeksu, Google ją przeszuka i opuści bez indeksowania. Narzędzie zadziałało. Strona nie przeszła.

Kilka czynników, które bezpośrednio wpływają na to, czy zindeksowana strona zostanie zachowana w indeksie:

**Jakość i głębia treści **– Strony, które dokładnie omawiają dany temat, odpowiadają na prawdziwe zapytanie i wnoszą coś nowego do indeksu, osiągają lepsze wyniki niż treści ubogie lub będące jedynie parafrazą, niezależnie od liczby wysłanych sygnałów indeksowania.

Platforma "wszystko w jednym" dla skutecznego SEO

Za każdym udanym biznesem stoi silna kampania SEO. Ale z niezliczonych narzędzi optymalizacji i technik tam do wyboru, może być trudno wiedzieć, gdzie zacząć. Cóż, nie obawiaj się więcej, ponieważ mam właśnie coś, co może pomóc. Przedstawiamy Ranktracker - platformę all-in-one dla skutecznego SEO.

W końcu otworzyliśmy rejestrację do Ranktrackera całkowicie za darmo!

Załóż darmowe kontoLub Zaloguj się używając swoich danych uwierzytelniających

**Struktura strony **– Przejrzysta hierarchia nagłówków (H1, H2, H3), logiczny przebieg treści i odpowiednie linkowanie wewnętrzne pomagają robotowi Googlebot zrozumieć i sklasyfikować stronę. Strony o dobrej strukturze łatwiej jest utrzymać w indeksie niż te źle zorganizowane.

**Stan techniczny **– Długie czasy ładowania, zablokowane zasoby, uszkodzone elementy i sprzeczne tagi kanoniczne dają Googlebotowi powody do obniżenia priorytetu strony. Spełnienie wymagań Core Web Vitals i utrzymanie stron w dobrym stanie technicznym eliminuje przeszkody w tym procesie.

**Sygnały linków **- Strony bez linków wewnętrznych i bez sygnałów odkrywalności zewnętrznej wydają się mieć niski priorytet. Zbudowanie pewnego kapitału linkowego do strony przed lub równolegle z zgłoszeniem do indeksowania zwiększa szansę, że zindeksowana strona pozostanie w indeksie, a nie wypadnie z niego.

Narzędzia do indeksowania są najskuteczniejsze, gdy jakość strony już spełnia wymagania Google. Szybsze doprowadzenie Googlebota do strony nie zmienia jego decyzji po jej dotarciu.

Zalecany przebieg pracy

| Scenariusz | Zalecane podejście |

| Własne strony | Najpierw Google Search Console – bezpłatne i zgodne z zasadami white hat |

| Treści poziomu 1, w przypadku których liczy się czas | Kolejka VIP w Rapid Indexer lub Indx.it |

| Precyzyjne indeksowanie zweryfikowane przez AI | Indexceptional (zwrot środków w razie niepowodzenia) |

| Linki zwrotne od stron trzecich, hurtowo | Narzędzie do indeksowania linków zwrotnych (automatyczny zwrot kosztów pokrywa ryzyko) |

| Duże partie, stopniowe tempo | Giga Indexer – stopniowe wprowadzanie |

| Sygnały rankingowe + wzrost ruchu | Udostępnianie w mediach społecznościowych wraz z płatnym indeksowaniem |

Najbardziej niezawodnym podejściem jest połączenie bezpłatnych metod dla treści własnych z płatnym narzędziem do indeksowania stron zewnętrznych – zamiast domyślnego stosowania wyłącznie płatnych narzędzi we wszystkich przypadkach. Udostępnianie w mediach społecznościowych sprawdza się najlepiej jako uzupełnienie płatnego indeksowania ważnych stron, a nie jako jego zamiennik. W przypadku kampanii konkurencyjnych uruchomienie głównego narzędzia do indeksowania wraz z etapem weryfikacji daje dokładniejszy obraz tego, co faktycznie zostało zindeksowane, a co nadal znajduje się w kolejce.