Einleitung

Die Veröffentlichung einer Seite bedeutet nicht, dass Google sie gefunden hat.

Die Lücke zwischen der Veröffentlichung einer URL und ihrer Aufnahme in den Index durch Google ist eines der am meisten unterschätzten Probleme im Bereich SEO. Für inhaltsreiche Websites, Linkbuilder und Agenturen, die mehrere Kampagnen verwalten, führt diese Lücke direkt zu verzögerten Rankings, verschwendeter Link-Autorität und einem langsameren Return on Investment für Inhalte.

Es gibt Website-Indexierungstools, um diese Lücke zu schließen – durch das Erzeugen von Crawl-Signalen, das Aufbauen von Erkennungswegen und in einigen Fällen durch wiederholtes Einreichen von URLs, bis die Indizierung bestätigt ist.

Dieser Leitfaden behandelt die Tools, die es 2026 wert sind, eingesetzt zu werden, basierend auf Tests in laufenden Kampagnen, mit Hinweisen dazu, wo jedes einzelne in einen praktischen Arbeitsablauf passt.

Warum es zu Verzögerungen bei der Indizierung kommt

Google weist jeder Domain ein Crawl-Budget zu – eine begrenzte Menge an Ressourcen, die Googlebot zum Auffinden und Verarbeiten von Seiten nutzt. Mit dem Wachstum des Webs wird dieses Budget immer dünner verteilt.

Das praktische Ergebnis sind zwei häufige GSC-Fehlerzustände, die den meisten SEOs gut bekannt sind:

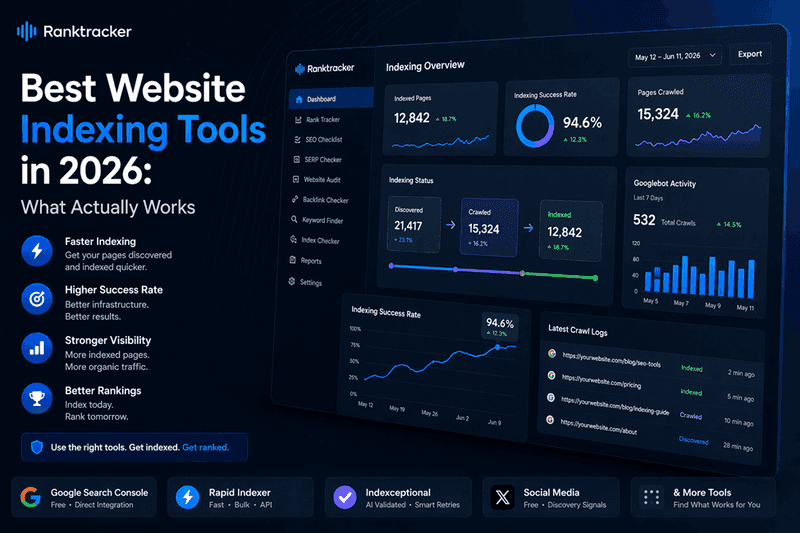

Die All-in-One-Plattform für effektives SEO

Hinter jedem erfolgreichen Unternehmen steht eine starke SEO-Kampagne. Aber bei den zahllosen Optimierungstools und -techniken, die zur Auswahl stehen, kann es schwierig sein, zu wissen, wo man anfangen soll. Nun, keine Angst mehr, denn ich habe genau das Richtige, um zu helfen. Ich präsentiere die Ranktracker All-in-One-Plattform für effektives SEO

Wir haben endlich die Registrierung zu Ranktracker absolut kostenlos geöffnet!

Ein kostenloses Konto erstellenOder melden Sie sich mit Ihren Anmeldedaten an

„Entdeckt – derzeit nicht indexiert“ bedeutet, dass Google die URL gefunden hat (in der Regel über eine Sitemap), aber noch keinen Googlebot zum Crawlen entsandt hat. Dies ist ein Warteschlangenproblem – Ihre Seite wartet darauf, an die Reihe zu kommen.

„Gecrawlt – derzeit nicht indexiert“ bedeutet, dass Googlebot die Seite besucht hat, aber entschieden hat, sie nicht in den Index aufzunehmen. Dies ist ein Qualitäts- oder Relevanzproblem – das Tool hat seine Arbeit getan, aber der Inhalt hat Googles Schwellenwert nicht erreicht.

Indexierungstools lösen das erste Problem zuverlässig. Das zweite erfordert eine Verbesserung der zugrunde liegenden Seite. Diese Unterscheidung ist wichtig, wenn es darum geht, zu entscheiden, wofür das Budget ausgegeben werden soll.

Die Tools

1. Google Search Console

Die kostenlose Option, die von Google selbst entwickelt wurde – und der sauberste Ansatz für Seiten, die Sie besitzen und direkt kontrollieren. Mit dem URL-Prüftool können Sie manuell das Crawlen für jede URL auf einer verifizierten Website anfordern. Für neue Inhalte, aktualisierte Seiten oder alles, was im Abdeckungsbericht markiert ist, ist eine manuelle Anfrage die sauberste und kostenlose Option. Es gibt drei wesentliche Einschränkungen, die Sie kennen sollten, bevor Sie sich darauf verlassen. Erstens unterliegt es einer starken Ratenbegrenzung – Sie können pro Tag nur eine geringe Anzahl von URLs manuell einreichen, was es für die Massenindexierung unpraktisch macht. Zweitens funktioniert es nur für Domains, deren Eigentumsrechte Sie verifiziert haben – für Backlink-Seiten von Drittanbietern, Gastbeiträge oder URLs auf einer anderen Domain ist es keine Option. Drittens kann die Indizierung selbst bei erfolgreicher Übermittlung der Anfrage noch Tage dauern, anstatt der wenigen Minuten, die mit kostenpflichtigen Tools wie Rapid Indexer erreicht werden. Es ist die sauberste verfügbare Methode, aber nicht die schnellste.

Am besten geeignet für: Eigene Seiten, neue Inhalte, Behebung von GSC-Fehlern

Kosten: Kostenlos

2. Rapid Indexer

Die derzeit leistungsstärkste kostenpflichtige Option in Bezug auf Geschwindigkeit und Infrastruktur – und eines von zwei Tools auf dieser Liste, das AI-validierte Einreichungen anbietet.

Rapid Indexer arbeitet mit zwei Einreichungsstufen. Die Standard-Warteschlange nutzt ein nach und nach gespeistes Autoritätsnetzwerk, um Masseneinreichungen innerhalb von 24 bis 48 Stunden zu verarbeiten – geeignet für Zitate, Tier-2/3-Links und große Stapel, bei denen eine schrittweise Erkennung natürlich wirkt. Die VIP-Warteschlange ist für Seiten mit hoher Priorität ausgelegt und erreichte in unseren Tests eine Crawl-Erkennung in unter zwei Minuten – das schnellste Ergebnis, das wir bei allen getesteten Tools verzeichneten.

Die All-in-One-Plattform für effektives SEO

Hinter jedem erfolgreichen Unternehmen steht eine starke SEO-Kampagne. Aber bei den zahllosen Optimierungstools und -techniken, die zur Auswahl stehen, kann es schwierig sein, zu wissen, wo man anfangen soll. Nun, keine Angst mehr, denn ich habe genau das Richtige, um zu helfen. Ich präsentiere die Ranktracker All-in-One-Plattform für effektives SEO

Wir haben endlich die Registrierung zu Ranktracker absolut kostenlos geöffnet!

Ein kostenloses Konto erstellenOder melden Sie sich mit Ihren Anmeldedaten an

Der zugrunde liegende Mechanismus kombiniert Cloud-API-Signale mit der Einbindung von Feeds mit hoher Autorität und löst echte Googlebot-Besuche aus, die über Crawl-Log-Überwachungstools unabhängig überprüft werden können. Vor der Verarbeitung werden URLs auf ihren HTTP-Antwortstatus und ihre Crawl-Bereitschaft überprüft – so werden keine Credits für 404-Fehler oder defekte Weiterleitungen verschwendet. URLs, die beim ersten Durchlauf nicht indexiert werden, werden mithilfe einer adaptiven Wiederholungslogik automatisch erneut eingereicht.

Es enthält außerdem ein KI-Traffic-Modul, das über private IP-Adressen Engagement-Signale (CTR, Verweildauer, Scrolltiefe) generiert – relevant für Seiten, bei denen neben der reinen Indizierung auch Signale zum Nutzerverhalten eine Rolle spielen.

Für Agenturen bietet es die Massenverarbeitung von bis zu 10.000 URLs, API-Zugriff, Zapier-/Make-/n8n-Integration, ein WordPress-Plugin, White-Label-CSV-Berichte und automatische Rückerstattungen bei Indexierungsfehlern.

Am besten geeignet für: Schnelle Tier-1-Indexierung, Agentur-Workflows, Massenkampagnen

Preise: 0,001 $/URL (Test), 0,02 $/URL (Standard), 0,10 $/URL (VIP)

3. Indexceptional

Indexceptional wurde Mitte 2024 von James Dooley und Leo Soulas gegründet und deckt denselben Kernfunktionsumfang wie Rapid Indexer ab – KI-gestützte URL-Validierung, adaptive Wiederholungslogik bei fehlgeschlagenen Übermittlungen und private Crawl-Netzwerke mit intelligenter Ping-Planung für eine konsistente langfristige Indizierung.

Der wesentliche Unterschied liegt in der Rückerstattungsrichtlinie für Guthaben. Für jede URL, die nicht indexiert wird, wird das Guthaben automatisch zurückerstattet – das heißt, Sie zahlen nur für bestätigte Ergebnisse. Diese Garantie bietet eine zusätzliche finanzielle Absicherung, wodurch sich der Dienst besonders gut für größere Stapel eignet, bei denen mit einigen Indexierungsfehlern zu rechnen ist.

Der Nachteil ist der Preis – Indexceptional ist pro URL etwas teurer als Rapid Indexer und enthält kein Modul zur Traffic-Simulation. Für Kampagnen, bei denen die Rückerstattungsgarantie die höheren Kosten aufwiegt, ist es eine starke Option neben oder anstelle von Rapid Indexer.

Bewertet mit 4,8 Sternen bei über 300 verifizierten Bewertungen und Gewinner eines Community-SEO-Utility-Awards im Jahr 2025.

Am besten geeignet für: KI-validierte Indizierung mit Rückerstattungsschutz, Agenturen, die garantierte Ausgabeneffizienz wünschen

Preise: 29 $ (60 Credits) bis 499 $ (2.000 Credits). 1 Credit = 1 URL. Ungültige URLs und Weiterleitungen werden nicht berechnet. Credits für nicht indexierte Links werden zurückerstattet.

4. Teilen in sozialen Medien

Eine kostenlose Methode, die man kennen sollte – mit wichtigen Einschränkungen hinsichtlich Zuverlässigkeit und Umfang.

Wenn eine URL öffentlich auf Twitter/X, Reddit, LinkedIn oder ähnlichen Plattformen mit hoher Crawl-Frequenz geteilt wird, entsteht eine crawlbare Seite, der Googlebot folgen kann. Auf Plattformen mit hoher Crawl-Frequenz wie Reddit und Twitter/X kann dies manchmal schon innerhalb von Stunden nach der Veröffentlichung zur Erkennung führen.

Das entscheidende praktische Detail: Teilen Sie die URL der Backlink-Seite selbst, nicht nur Ihre Hauptwebsite. Wenn ein Gastbeitrag oder ein Nischen-Edit indexiert werden soll, schafft das Teilen dieser spezifischen URL einen Erkennungsweg, der direkt auf die Seite verweist, die gefunden werden soll.

Die Einschränkungen sind jedoch real. Das Crawlen über Social Shares ist nicht garantiert – Googlebot folgt dem Link je nach den aktuellen Crawling-Mustern der Plattform möglicherweise oder auch nicht. Es lässt sich auch nicht praktisch auf große Link-Stapel skalieren, und die Signalstärke ist im Vergleich zu kostenpflichtigen Tools inkonsistent.

Der eigentliche Mehrwert liegt in den Folgewirkungen. Social Shares generieren echten Traffic auf Seiten, und echter Traffic erzeugt authentische Engagement-Signale – Verweildauer auf der Seite, wiederkehrende Besuche, Klickmuster –, die das Ranking über die anfängliche Indizierung hinaus unterstützen können. Bei wichtigen Seiten sorgt die Kombination aus einem kostenpflichtigen Indexer und Social Amplification sowohl für zuverlässige Auffindbarkeit als auch für kontinuierliche Ranking-Signale.

Am besten geeignet für: Ergänzende Erkennungssignale, Generierung von echtem Traffic auf wichtigen Seiten, kostenlose Erstellung von Crawl-Pfaden

Kosten: Kostenlos

Hinweis: Als eigenständige Indexierungsmethode in großem Maßstab nicht zuverlässig

5. Backlink-Indexierungstool

Seit 2021 in Betrieb, mit einer Richtlinie, die sich vom Rest des Marktes abhebt: automatische Gutschriften für jede URL, die nicht indexiert wird. Sie zahlen nur für bestätigte Ergebnisse.

Es führt parallele Signale über Googlebot, Bingbot und Yandex aus – eine breitere Suchmaschinenabdeckung als bei Tools, die sich ausschließlich auf Google konzentrieren. Die durchschnittliche Erfolgsquote in unseren Tests liegt bei 89 %, wobei die meisten Links innerhalb von 1–5 Tagen indexiert werden und der erste Googlebot-Crawl in der Regel innerhalb von 1–6 Stunden nach der Einreichung erfolgt.

Die Rückerstattungsrichtlinie beseitigt das finanzielle Risiko bei großen Massenkampagnen auf eine Weise, die derzeit kein anderes Tool bietet.

Am besten geeignet für: Backlink-Massenkampagnen, risikofreie Ausgaben für große Datenmengen

Preise: 30 $ (100 Credits), 135 $ (500 Credits), 510 $ (2.000 Credits)

6. Indx.it

Ein Indexierungstool mit schneller Bearbeitungszeit, das Erkennungszeiten von 1–5 Minuten angibt – in puncto Geschwindigkeit vergleichbar mit der VIP-Warteschlange von Rapid Indexer.

Funktioniert nach einem Pay-as-you-go-Credit-Modell, für das kein Abonnement erforderlich ist. Die Preise liegen pro URL etwas über denen von Rapid Indexer. Das Dashboard ist sowohl für einzelne Einreichungen als auch für die wiederkehrende Nutzung übersichtlich gestaltet.

Eine nützliche Zweitoption für Tier-1-Links, bei denen Geschwindigkeit Priorität hat und eine Verteilung der Einreichungen auf mehrere Infrastrukturen bevorzugt wird.

Am besten geeignet für: Tier-1-Einreichungen mit schneller Bearbeitungszeit, Diversifizierung der Infrastruktur

Preise: Pay-as-you-go, Credits verfallen nicht

7. Giga Indexer

Die flexibelste Option auf dieser Liste zur Steuerung des Einreichungstempos – Drip-Feed-Fenster reichen von sofort bis zu 30 Tagen.

Bei großen Link-Stapeln, bei denen ein allmähliches, natürlich wirkendes Entdeckungsmuster wichtig ist, ist diese Art der Geschwindigkeitssteuerung wirklich nützlich. Die Erfolgsquote liegt in unseren Tests bei 80 % innerhalb von 72 Stunden, mit einer 9-tägigen Rückerstattungsgarantie für nicht indexierte Links.

**Am besten geeignet für: **Große Stapel, die eine schrittweise Einreichung erfordern, Tier-2/3-Links

**Preise: **29 $ (60 Credits), 99 $ (260 Credits), 499 $ (2.000 Credits)

Was Indexierungstools nicht leisten können

Das sollte man sich klar vor Augen führen, bevor man Geld für eines der oben genannten Tools ausgibt.

Ein Indexierungstool sorgt dafür, dass Googlebot eine URL besucht. Es kann nicht beeinflussen, wie Google entscheidet, sobald es dort angekommen ist. Wenn die Seite dünnen Inhalt, doppelten Text enthält oder dem Index nichts Neues hinzufügt, wird Google sie crawlen und ohne Indexierung wieder verlassen. Das Tool hat funktioniert. Die Seite hat nicht bestanden.

Einige Faktoren, die direkt beeinflussen, ob eine gecrawlte Seite indexiert und beibehalten wird:

**Qualität und Tiefe des Inhalts **��– Seiten, die ein Thema gründlich behandeln, eine echte Suchanfrage beantworten und etwas Neues in den Index einbringen, schneiden besser ab als dünner oder stark paraphrasierter Inhalt, unabhängig davon, wie viele Crawling-Signale gesendet werden.

Die All-in-One-Plattform für effektives SEO

Hinter jedem erfolgreichen Unternehmen steht eine starke SEO-Kampagne. Aber bei den zahllosen Optimierungstools und -techniken, die zur Auswahl stehen, kann es schwierig sein, zu wissen, wo man anfangen soll. Nun, keine Angst mehr, denn ich habe genau das Richtige, um zu helfen. Ich präsentiere die Ranktracker All-in-One-Plattform für effektives SEO

Wir haben endlich die Registrierung zu Ranktracker absolut kostenlos geöffnet!

Ein kostenloses Konto erstellenOder melden Sie sich mit Ihren Anmeldedaten an

**Seitenstruktur **– Eine klare Überschriftenhierarchie (H1, H2, H3), ein logischer Ablauf und eine korrekte interne Verlinkung helfen Googlebot, eine Seite zu verstehen und zu kategorisieren. Gut strukturierte Seiten lassen sich leichter im Index behalten als schlecht organisierte.

**Technischer Zustand **– Lange Ladezeiten, blockierte Ressourcen, defekte Elemente und widersprüchliche Canonical-Tags geben Googlebot Anlass, eine Seite herabzustufen. Das Erfüllen der Core Web Vitals und die technische Sauberkeit der Seiten sorgen für einen reibungslosen Ablauf.

**Linksignale **– Seiten ohne interne Links und ohne externe Signale zur Auffindbarkeit wirken wenig wichtig. Der Aufbau von Link-Equity für eine Seite vor oder parallel zur Indexierungsanmeldung erhöht die Chance, dass eine gecrawlte Seite im Index verbleibt, anstatt wieder herauszufallen.

Indexierungstools sind am effektivsten, wenn die zugrunde liegende Seitenqualität bereits Googles Schwellenwert erfüllt. Googlebot schneller dorthin zu bringen, ändert nichts daran, wie es entscheidet, wenn es dort ankommt.

Empfohlener Arbeitsablauf

| Szenario | Empfohlener Ansatz |

| Ihre eigenen Seiten | Zuerst Google Search Console – kostenlos und White-Hat |

| Zeitkritische Tier-1-Inhalte | Rapid Indexer VIP-Warteschlange oder Indx.it |

| KI-validierte Präzisionsindexierung | Indexceptional (Gutschrift bei Fehlern) |

| Backlinks von Drittanbietern, Massenverarbeitung | Backlink-Indexierungstool (automatische Rückerstattung deckt das Risiko ab) |

| Große Stapel, schrittweise Verarbeitung | Giga Indexer mit schrittweiser Zuführung |

| Ranking-Signale + Traffic-Steigerung | Teilen in sozialen Medien neben bezahlter Indizierung |

Der zuverlässigste Ansatz besteht darin, kostenlose Methoden für eigene Inhalte mit einem kostenpflichtigen Indexer für Seiten von Drittanbietern zu kombinieren – anstatt pauschal auf kostenpflichtige Tools zurückzugreifen. Das Teilen in sozialen Netzwerken funktioniert am besten als Ergänzung zur kostenpflichtigen Indexierung wichtiger Seiten, nicht als Ersatz dafür. Bei wettbewerbsorientierten Kampagnen liefert der Einsatz eines primären Indexers in Verbindung mit einem Verifizierungsschritt ein genaueres Bild davon, was tatsächlich bereits indexiert wurde und was noch in der Warteschlange steht.